Minitel funzionava nel 1981, il primo uso privato di Internet è di dieci anni dopo. La Programma 101 dell’Olivetti è del 1965, il personal IBM di dieci anni dopo, il Mac quasi di venti. Quaero, il motore di ricerca europeo che doveva far concorrenza a Google e a Yahoo! è del 2005; Qwant gli succede otto anni e molti miliardi dopo, e oggi aspira a prendere il 5% del mercato. Perché oggi l’Europa tra i grandi ha solo Spotify (che vale un ventesimo di Facebook) e SAS (che fa un altro mestiere)? Per capire le cause di questa singolarità è utile confrontare l’apparato ideologico alla base dell’articolo di Fabrizio Barca (12.4 su la Voce.info) con l’ambiente culturale in cui si è formata la società delle piattaforme.

Nei primi anni ‘70 i computer godevano della dubbia reputazione di essere strumento di controllo, di governi orwelliani o delle multinazionali. La controcultura della fine degli anni ‘60 univa valori di comunità e collettività con quelli di libertà e potere personali, in aperto contrasto con l’oppressione associata alla tecnologica informatica: solo alla fine degli anni ’70 la tecnologia è vista come strumento di potenziale liberazione. Nel 1991 Il World Wide Web dà nuovo impulso ai legami tra cultura informatica e controcultura. C’era il desiderio di formare comunità connesse: la crescente richiesta di connettibilità attirò le imprese, interessate a fornire connettività. Dal 2000 al 2005 le piattaforme prosperano con l’entusiasmo degli utenti, spazi alternativi, liberi dai vincoli di aziende e governi. Mettendo “you” come persona dell’anno (2006), Time proclama il potere rivoluzionario degli utenti connessi. Il resto della storia lo conosciamo: l’effetto rete, il winner takes all , la polarizzazione delle grandi piattaforme, ciascuna nel suo settore, con la sua identità di impresa.

Per Barca invece il risultato è una “crescente concentrazione del controllo sulla conoscenza […]. La tecnologia dell’informazione, che ha il potenziale per diffondere il controllo della conoscenza, è stata impiegata per ottenere il risultato opposto”. Crescente? Controllo? Wikipedia, che consente di accedere con un click a 300 lingue, in italiano 1 milione e mezzo di voci; Google che ogni giorno esamina 20 miliardi di pagine web e risponde a 4,5 miliardi di richieste, “concentrano il controllo della conoscenza”? Se Bing ha il 7% del mercato, Baidu il 6%, Yayoo! il 5% è per il diabolico “controllo” di Google o per i suoi giganteschi investimenti a scannerizzare milioni di libri? Se la “crescente concentrazione del controllo della conoscenza” è dubbia (o incomprensibile), come ha potuto produrre la concentrazione della ricchezza? Certo che questa esiste, ma va trattata con argomentaste analisi.

I pericoli del digitale di Stato

Le altre accuse di Barca agli algoritmi di ricerca sono di repertorio. Propagherebbero i bias – etnici , religiosi, sessuali -di chi li ha progettati: ma sono i proprietari stessi che si affrettano a correggerli, per guadagnarsi a costo zero medaglie di politically correct. Farebbero vivere gli utenti in una bolla: ma anche offline viviamo nella bolla delle nostre conoscenze e abitudini, online almeno siamo esposti alle sconfinate possibilità – e tentazioni- di esplorare terreni nuovi. Non stigmatizza, come Margrethe Vestager, i Big Tech per le acquisizioni delle start-up promettenti, cosa che ridurrebbe la possibilità di concorrenza futura: che invece così aumenta, la start-up acquistata essendo il miraggio per migliaia di altre che lottano per essere loro le prescelte. La cultura dell’ecosistema in cui nacquero le grandi piattaforme è radicalmente differente da quella che vi vede la “concentrazione del controllo delle conoscenze”: lì non cresce nulla.

La solita accusa di vendere a caro prezzo i dati che ci vengono gratuitamente sottratti induce Barca ad auspicare la “sovranità collettiva sui dati personali” e l’assegnazione al pubblico del “patrimonio pubblico costruito dalle infrastrutture pubbliche di ricerca”. Nella maggior parte delle nazioni OCSE aumenta la quota di R&D privato sul totale, per Barca invece si dovranno “contrastare le loro posizioni di monopolio attraverso la costituzione di un’impresa pubblica europea”, realizzando “piattaforme digitali a sovranità collettiva”. Così l’impossibilità di un’utopia –i Big Tech europei – diventa la distopia – il “digitale di Stato”.

I giganti del web magari non garantiscono la privacy, non filtrano in tempo fake news e hate speech: ma siamo protetti, non hanno altro scopo che di fare soldi, se sbagliano, gli azionisti vendono e il titolo crolla, gli utenti abbandonano e gli analisti bocciano. Che anche da noi il controllo delle aziende, e quindi dei dati che estraggono, sia sottratto al giudizio del mercato e degli utenti, che il governo controlli le aziende che possono controllare noi: questa è la prospettiva da incubo, questa sì che sarebbe la vera, assoluta, totale “concentrazione del controllo della conoscenza” e, perché no?, della coscienza. Avviene nei Paesi totalitari. Quella da ”incalzare come cittadini organizzati” è l’eventualità che una simile prospettiva si realizzi. Meglio neppure evocarla.

Sarà l’Europa ad arginare lo strapotere degli algoritmi?

di Fabrizio Barca – lavoce.info – 12 aprile 2019

La forte e crescente concentrazione del controllo sulla conoscenza e l’uso improprio degli algoritmi non sono il frutto inevitabile della tecnologia dell’informazione, ma di scelte politiche. Oggi però si aprono nuove possibilità per invertire la rotta.

La concentrazione del controllo sulla conoscenza

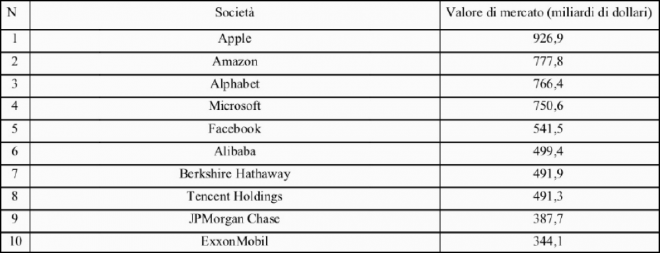

Che sia avvenuto un forte e diffuso aumento della concentrazione di ricchezza è fatto acquisito: in Italia, fra 1996 e 2016, la quota di ricchezza netta posseduta dal 10 per cento più ricco è passata da meno del 50 per cento a oltre il 60, quella dei primi 5mila adulti dal 2 al 7 per cento. Oggi sta crescendo la consapevolezza, anche nella cultura liberale, che a questa tendenza ha concorso una crescente concentrazione del controllo sulla conoscenza. Ne sono indizi eclatanti sia il fatto che sette delle prime dieci imprese del mondo si basano su tecnologie dell’informazione (figura 1), sia il “disprezzo” del vertice di una di queste imprese verso i rappresentanti eletti del popolo.

Figura 1– Le prime dieci società del mondo per valore di mercato nel 2018

Fonte: M. Florio, F. Giffoni, “L’impatto sociale della produzione di scienza su larga scala: come governarlo?”

Come argomenta il Rapporto “15 Proposte per la giustizia sociale”del Forum disuguaglianze e diversità(ForumDD), seguendo l’analisi di Anthony Atkinson, questa situazione non è ineluttabile. Se la tecnologia dell’informazione, che ha il potenziale per diffondere il controllo della conoscenza, è stata impiegata per ottenere il risultato opposto, ciò è dovuto a scelte politiche compiute negli ultimi trenta anni. Che possono e devono essere invertite. Si tratta di correggere l’esasperazione della protezione della proprietà intellettuale realizzata con l’Accordo Trips (Agreement on Trade Related Aspects of Intellectual Property Rights) del 1995, di risolvere il paradosso per cui il patrimonio pubblico di open science costruito da infrastrutture pubbliche di ricerca (oltre mille in Europa) viene privatizzato al momento di produrre le innovazioni, di assegnare alle nostre imprese pubbliche un ruolo strategico di promotrici di concorrenza.

Sovranità collettiva sui dati personali

A questi interventi deve aggiungersi un’azione per costruire una “sovranità collettiva” sui dati personali e sugli algoritmi di apprendimento automatico, ossia i modelli che, utilizzando grandi masse di dati, ricercano correlazioni fra fenomeni e forniscono previsioni su cui basare decisioni.

L’utilizzo degli algoritmi tocca oggi ogni dimensione di vita: il lavoro (reclutamento, valutazione, orari), le politiche pubbliche (assistenza sociale e sicurezza), la politica (informazione, propaganda), il consumo di servizi e beni sul mercato (prodotti in rete e pubblicità, intrattenimento, servizi di trasporto e turistici, credito, assicurazioni).

È su quest’ultimo terreno che gli algoritmi hanno raccolto il nostro, spesso incondizionato, consenso, permettendoci di conoscere all’istante le varianti di un prodotto desiderato e poi di acquisirlo con tempestività; offrire sul mercato prodotti e incontrare la “loro” domanda; moltiplicare le possibilità di intrattenimento. Accanto a questi e altri vantaggi, l’impiego degli algoritmi crea rischi sistematici per la giustizia sociale, ovvero per la “capacità di ciascuno di noi di fare le cose a cui assegna valore”.

Gli algoritmi di apprendimento automatico, forti di un apparente crisma di oggettività tecnica, tendono infatti a riprodurre in modo sistematico le discriminazioni del contesto a cui sono applicati (nel selezionare personale, determinare condizioni di credito, per esempio); replicare e amplificare pregiudizi istintivi; segmentare i consumatori o l’elettorato in micro-gruppi destinatari di messaggi dedicati e non comunicanti. Se utilizzati nelle politiche sociali e di cura della salute, gli algoritmi conducono a trattare ogni persona come membro del “gruppo” al quale viene assimilata, togliendo al servizio la fondamentale componente di riconoscimento dell’identità e delle problematiche e potenzialità personali. Tutto ciò avviene all’interno di uno scambio ineguale, in cui i dati personali che riversiamo in rete sono utilizzati senza essere remunerati e al di fuori del nostro controllo. Come è stato scritto: “le sirene dei server offrono servizi utili e godibili, impossessandosi del valore di mercato che noi in cambio produciamo”.

La risposta europea

La risposta a questa deriva sta crescendo. In Europa – con il regolamento generale per la protezione dei dati la Ue ha stabilito principi rilevanti per la tutela dall’abuso degli algoritmi – vi sono le condizioni per l’azione integrata descritta nel Rapporto. Si tratta di mettere alla prova il regolamento, incalzare i giganti del digitale come cittadini organizzati, valutare la possibilità di contrastare le loro posizioni di monopolio attraverso la costituzione di un’impresa pubblica europea, promuovere un equilibrio di genere – oggi le donne sono gravemente sotto-rappresentate nei ruoli di programmazione informatica – e un mix disciplinare nei team che elaborano gli algoritmi, sperimentare piattaforme digitali a “sovranità collettiva” specie per la produzione di servizi, moltiplicare i dataset (con dati amministrativi) aperti all’utilizzo da parte di comunità di innovatori in rete. L’esperienza di alcuni comuni italiani, impegnati oggi in un’alleanza con altre città del mondo, muove in alcune di queste direzioni. Con esse e con altri soggetti il ForumDD sarà da oggi impegnato.

Contro-risposta di Fabrizio Barca del 19 aprile 2019.

Leggo il commento di Franco Debenedetti di ritorno da un affollato incontro a Trieste con scienziati politici, informatici, fisici, amministratori della salute e storici sulle proposte del Forum Disuguaglianze e Diversità, e segnatamente su quelle che mirano a ribilanciare i poteri nell’impiego dei nostri dati personali e nell’uso degli algoritmi di apprendimento automatico. La parola “ideologia” non ha sfiorato nessuno di noi, perché ben sappiamo, persone con opinioni diverse, che viene usata quando non si vuole affrontare il merito delle cose.

Nel Rapporto a cui la nota de lavoce.info rinviava scriviamo: «Come molte altre tecniche, gli algoritmi e il sistema tecnologico a cui danno vita non sono in sé né “giusti” né “ingiusti”. Dipende da come sono utilizzati e precisamente: dal fatto che considerazioni di giustizia sociale siano incorporate nella scelta dei dati, negli obiettivi del modello e nel loro uso; dalla possibilità che chi è influenzato dalle “decisioni” degli algoritmi pesi sulla scelta di quegli obiettivi e di quei dati; e, prima ancora, che egli/ella possa controllare l’uso dei dati identitari forniti. Tuttavia, più di altre tecnologie sviluppate nell’ultimo decennio, la biforcazione aperta dal sistema tecnologico di decisioni automatiche, fondate su algoritmi e big data, appare decisamente sbilanciata a sfavore della giustizia sociale. Questo sbilanciamento ha natura fisiologica».

Di questo sbilanciamento e degli otto rischi per le nostre diverse dimensioni di vita – descritti in dettaglio nel Rapporto – sono oggi consapevoli studiosi, esperti, amministratori, cittadini di ogni cultura, a cominciare da coloro che allo sviluppo della rete e dei suoi dispositivi hanno dato un contributo decisivo come strumento di libertà e democrazia. Scrive, fra questi, Tim Berners-Lee nella pagina introduttiva del sito della World Wide Web Foundation: “il web libero e aperto si trova ad affrontare sfide concrete. Più della metà della popolazione mondiale non può ancora accedere alla rete. Per l’altra metà i benefici del web sono accompagnati da troppi rischi: per la nostra privacy, per la nostra democrazia, per i nostri diritti” (The free and open web faces real challenges. More than half the world’s population still can’t get online. For the other half, the web’s benefits come with too many risks: to our privacy, our democracy, our rights).

A tutti questi, ai liberali radicali autori di “Radical markets”, a noi del ForumDD, che mescoliamo culture diverse, non piace la “sovranità dei monopoli privati” e sappiamo dalla storia e dall’analisi economica che, a differenza di quanto sostiene Debenedetti, non sarà il mercato a fermare i monopoli. Per di più, un recente articolo di Emilio Calvano, Giacomo Calzolari, Vincenzo Denicolò e Sergio Pastorello mostra che utilizzando algoritmi per fissare i prezzi due imprese convergono su un prezzo di oligopolio senza neppure colludere. Né a tutti noi piace la “sovranità statale” sulla rete, di cui descriviamo gli insopportabili esiti autoritari in Cina.

Ecco perché individuiamo come obiettivo una “sovranità collettiva” della rete, di cui si cominciano a intravedere i tratti e a sperimentare le forme. Non esiste un solo strumento per arrivarci. Dobbiamo andare dall’aumento del grado di concorrenza nel mercato attraverso un’impresa digitale pubblica europea che incalzi i giganti del web, fino alla messa in rete di tutte le banche dati pubbliche: i dati sulla mobilità di una grande città non possono diventare proprietà dell’impresa che ha vinto l’appalto di servizio, ma devono essere accessibili da ogni gruppo di innovatori in rete che voglia offrire prodotti alternativi. E poi c’è il tema fondamentale di pretendere la pubblicità degli esiti delle ricerche condotte da Facebook o Google o della composizione multidiscilpinare e multigenere dei team di ricerca che sviluppano gli algoritmi e altro ancora.

Senza luddismi né idolatrie, senza incubi distopici costruiti per spaventare né sogni utopici costruiti per addomesticare, prendiamo dunque atto delle opportunità e dei rischi del dispositivo tecnologico fondato su dati personali e algoritmi. E confrontiamoci in modo ragionevole sulle cose possibili da fare per tornare a usare la modernità come leva di emancipazione.

Noi del ForumDD, assieme alle città e alle università già impegnate con noi e alle altre che vorranno farlo, siamo in cammino.

ARTICOLI CORRELATI

Do “data markets” exist?

di Vincenzo Zeno-Zencovich – Rivista di diritto dei media, febbraio 2019

aprile 19, 2019